Transformer 모델

트랜스포머는 현대 ML의 근간을 이루는 핵심 이론 중 하나다. 모든 LLM이 이걸 바탕으로 만들어졌다.

구글 딥마인드에서 2017년 냈던 논문 "Attention Is All You Need"에서부터 시작되었다.

여기서는 Transformer가 어떤 구조를 갖고 있고, 어떤 이유로 흥하게 된 것인지를 간략히 정리해본다.

수식이나 세부적인 구현보다는 개념 이해에 집중하려고 한다.

기존 모델의 문제 (RNN)

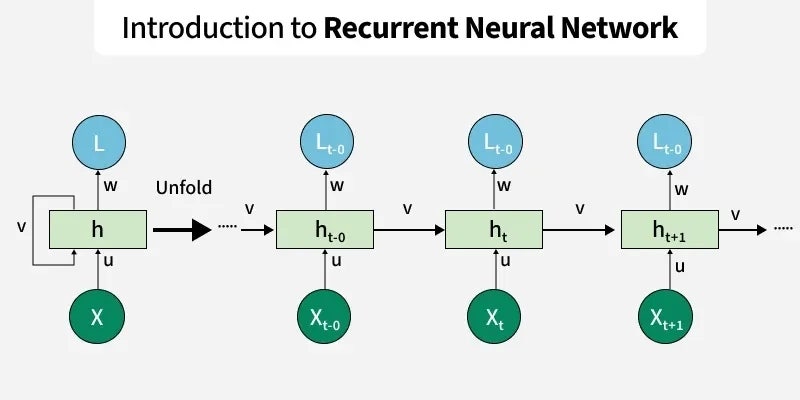

이전에 지배적으로 사용하던 모델 설계는 RNN(Recurrent Neural Network, 순환 신경망)이라는 것이었다.

https://www.geeksforgeeks.org/machine-learning/introduction-to-recurrent-neural-network/

https://www.geeksforgeeks.org/machine-learning/introduction-to-recurrent-neural-network/

이건 시퀀스(하나의 자연어 문장)를 처리할때, 단어를 분리한 뒤에 각 단어들을 순차적으로 처리하되, 각 단어의 출력(벡터)를 그 다음 입력으로도 계승시키는 순환 논리를 갖고 있다.

그리고 최종적으로 나오는 벡터값이 최종 응답이 되는 것이다.

이건 기존의 일반 신경망의 많은 문제들(메모리 효율성, 순서 정보 유지 등)을 개선했지만, 여전히 치명적인 단점들을 여러개 갖고 있었다.

일단, 처리 속도가 느렸다. 하나의 문장을 처리할때 단어를 하나씩 순서대로 처리해야 했기 때문에 병렬처리 수준이 매우 저조했다. 학습과 일반 추론 모두에 성능 저하를 유발하는 요인이었다.

게다가 정보 소실 문제도 심각했다. 각 단어에 대한 값이 계속 그 다음 단어로 간접 계승되긴 하나, 애초에 그 벡터란 것들이 근사치에 대한 값이기 때문에 온전하게 넘어가진 않는다. 그래서 문장이 길어질수록 맨 끝에서 유실되는 Vanishing Gradient 문제가 있었다.

트랜스포머의 기본 원리

그래서 트랜스포머 구조는 이런 RNN의 미묘한 단점들을 개선하기 위해 나왔다.

트랜스포머가 해결하고자 했던 주요 문제는 "학습/추론 속도를 극대화하는 것"이었고, 그걸 해결하는 방법이 단어 수준의 학습/추론을 병렬처리하는 것이었다.

https://lcyking.tistory.com/entry/%EB%85%BC%EB%AC%B8%EB%A6%AC%EB%B7%B0-Attention-is-All-you-need%EC%9D%98-%EC%9D%B4%ED%95%B4

https://lcyking.tistory.com/entry/%EB%85%BC%EB%AC%B8%EB%A6%AC%EB%B7%B0-Attention-is-All-you-need%EC%9D%98-%EC%9D%B4%ED%95%B4

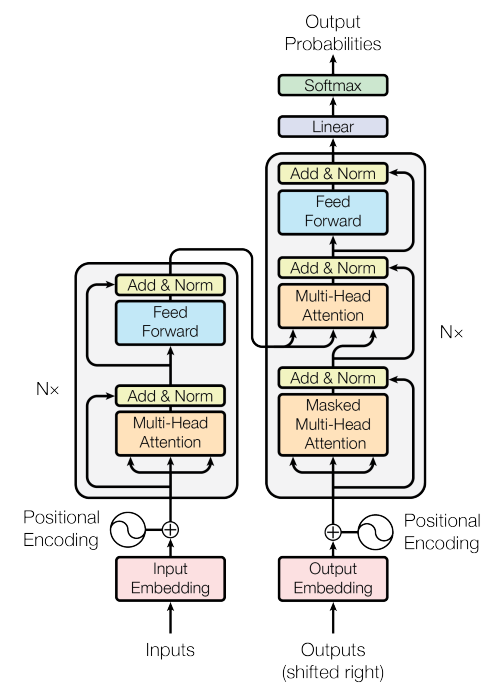

세부적으로 뜯어보면 이것저것 뭐가 많긴 하다.

트랜스포머 모델은 다음 과정을 거쳐서 텍스트를 처리한다.

1. 토큰화

자연어 문장이 들어오면, 일단 인코더 레이어에서는 문장을 단어 단위로 자른다.

"I Rust you" => ["I", "Rust", "you"]

이건 대부분의 자연어 처리 모델이 동일한 부분이다.

2. 위치

단어가 들어오면, 일단 단어마다 위치에 대한 정보를 추가한다.

이걸 Positional Encoding이라고 부르는데, 이를 통해 단어가 문장 내에서 위치하는 순서를 기록하고 그것이 의미있게 사용되게끔 하는 것이다.

3. 병렬처리

여기부터는 단어들을 순차적으로 처리하는 것이 아니라, 병렬적으로 처리한다.

이게 RNN과의 가장 큰 차이점이다. RNN은 I => Rust => You처럼 순차적으로 처리해야 했지만, 트랜스포머는 모든 단어를 동시에 처리할 수 있다. 각 단어마다의 벡터를 생성하고 그걸 최종적으로 결합하는 것이다.

4. Attention

개별 단어에 대한 추론은 Self-Attention과 Multi-head Attention을 통해 이루어진다. 약간 내용이 길어지므로, 상세한 매커니즘은 후술한다.

5. Feed-Forward

그리고 Multi-head Attention을 통해 한번 추론을 거쳤다면, 그걸 Feed-Forward Neural Network를 통해 다시 한번 정제하는 과정을 수행한다. 이를 통해서 문맥 정보를 정제한다.

6. 반복-레이어

Multi-Head Attention + Feed-Forward는 한번만 수행하는 것이 아니라, 정보가 어느 정도 완전해질때까지 반복된다. 이 한 흐름을 레이어라고 부르는데, 모델 베이스마다 레이어의 계층은 차이가 있다.

GPT-3의 경우에는 레이어가 96개였다.

**7. 최종 결합 **

루프를 충분히 돌았다면, 종국에는 각 단어별 벡터를 정리해서 최종 결과로 가공해야 한다.

여기엔 딱 정해진 방식은 없다. 단어별 벡터를 진짜 전부 다 쓸수도 있고, 벡터들을 결합해서 단일 벡터로 만들 수도 있다.

단일 벡터로 결합해야 한다면 softmax 같은 확률 분포 함수를 쓰곤 한다.

Attention Is All You Need

Attention은 결국 특정 단어가 다른 단어와 어떤 관계를 갖는지에 대한 이야기다.

그래서 실제로 Attention 기반 추론을 처리할 때는, 특정 단어가 다른 단어와 얼마나 집중(Attention)하는지를 가중치로 계산하고 관리한다.

예를 들어 "The cat sat on the mat because it was tired"라는 문장이 있다고 치면, it과 유사도가 가장 높은 단어는 "cat"이 될 것이다. 하지만 다른 단어들도 낮지만 유사도 점수를 가지고, 이를 통해 단어들 간의 관계로서 문장을 해석할 수 있다.

Self-Attention

트랜스포머 모델에서 이야기하는 Self-Attention은 한 문장 내에서, 단어가 다른 단어를 보고 문맥을 파악할 수 있게 한다는 뜻이다. 그래서 이를 통해 전체적인 문맥을 고려해서 값을 추론해낼 수 있다.

그리고 각 단어별로 독립적인 추론을 수행할 수 있다. 단어가 6개라면 6개 단어에 대한 추론을 병렬화한다.

**Multihead Attention **

이건 Self-Attention을 여러가지 관점에서 동시에 병렬로 돌리는 것을 말한다.

각각의 head가 한가지 관점에 대한 추론이고, 여러가지 관점을 동시에 돌린다고 multi-head다.

이를테면, 문법적 관계에 집중하는 추론 head가 있고, 의미적 관계에 집중하는 추론 head가 있거나 하는 식이다.

이런 다양한 추론들을 병렬적으로 처리한 뒤에, 그 결과를 마지막에 결합한다.

이를 통해 학습/추론 속도를 최적화한다.

트랜스포머의 장단점

장점

Self-Attention 매커니즘을 통해 긴 문장을 큰 손실 없이 잘 처리할 수 있다.

이게 대-LLM 시대를 이끌고 온 가장 큰 특성 중 하나라고 할 수 있다. 이전의 모델 베이스들은 문장이 길어질수록 정보가 손실되고 데이터가 깨져서 조악한 품질이 나오기 쉬웠다.

Multi-head attention를 통해서 문장을 다각도에서 분석하고 학습할 수 있다.

이것도 LLM의 자연어 처리 수준을 높인 주요 원인 중 하나다.

병렬처리 수준이 매우 높은 것도 중요한 장점 중 하나다.

많은 추론 단계를 순차가 아닌 병렬로 돌릴 수 있어서 GPU 활용도가 매우 높아졌고, 이게 엔비디아의 매출을 늘려준 가장 큰 요인이다.

단점

병렬화가 잘 된다는 것이, 연산 효율적이라는 의미는 아니다.

많은 자원이 있다면 그 리소스를 학대해서 더 빠른 시간 내에 처리할 수 있을 뿐이다.

그래서 연산 자원을 매우 크게 소모하며, 이게 GPU가 필수품으로 자리잡은 이유다.

많은 GPU 코어, 많은 메모리, 많은 전력량 소비가 따라오는 것도 이것 때문이다.

그리고 기존 모델 베이스에 비해서 많은 학습 데이터가 필요한 것도 단점이다.

multihead attension, FNN, 레이어 중첩 등으로 인해서 파라미터가 매우 많은 편인데, 그 때문에 고품질의 학습을 위해서는 많은 학습 데이터를 밀어넣을 필요가 있다.

근황

현재 LLM 모델들은 전부 이 모델을 근간으로 만들어져있다고 해도 과언이 아니다.

OpenAI의 GPT, Google Gemini, Anthropic의 Claude, DeepSeek 등 대부분의 주요 LLM 구현체들이 전부 Transformer를 베이스로 만들어졌고, 엄청난 혁신이 일어나지 않는 이상 이런 흐름은 한동안 더 이어질 것 같다.

참조

https://blogs.nvidia.co.kr/blog/what-is-a-transformer-model/

https://www.geeksforgeeks.org/machine-learning/introduction-to-recurrent-neural-network/

https://wikidocs.net/22886

https://wikidocs.net/31379